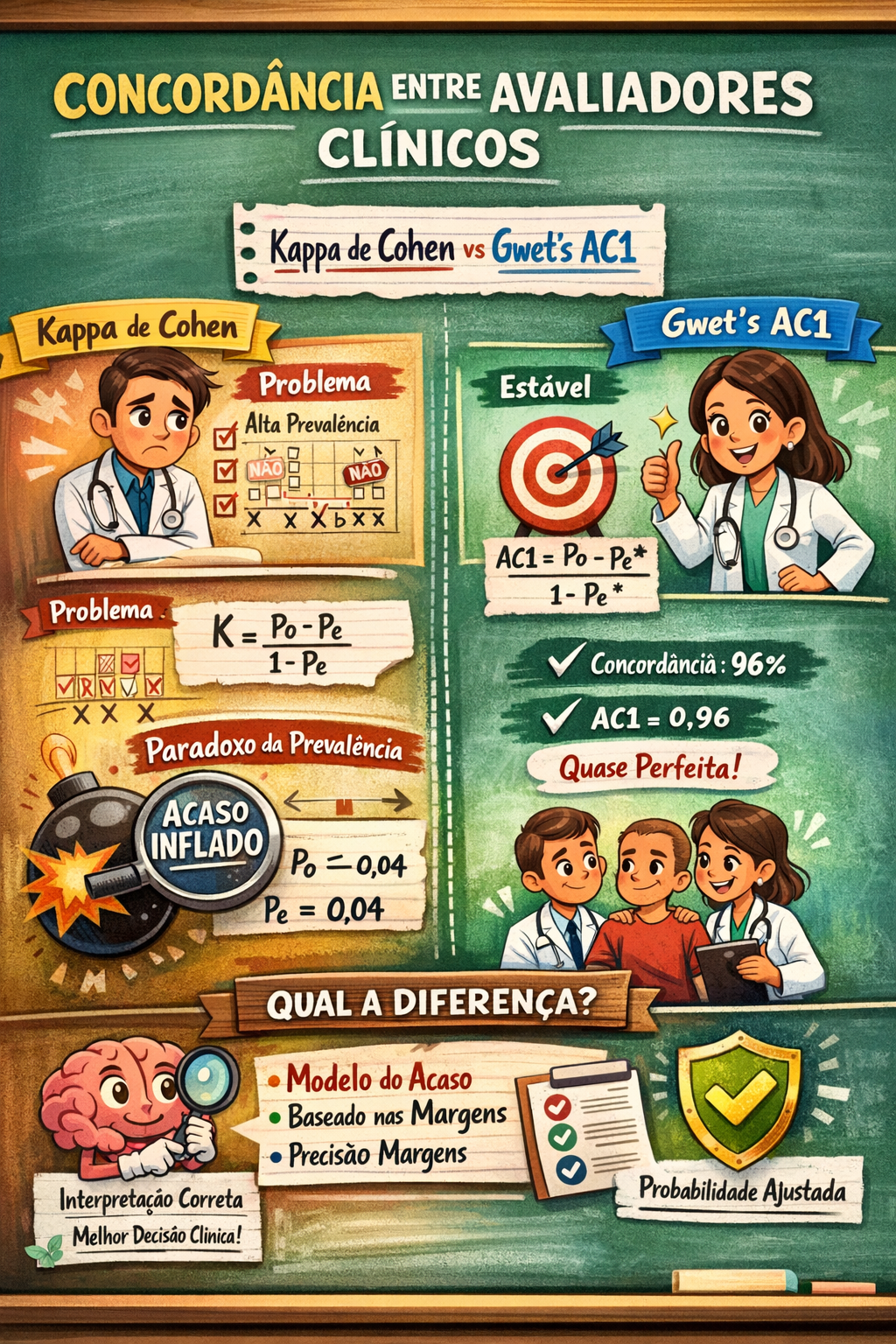

AC1 corrige distorções do Kappa e reflete melhor a concordância clínica real

Aldemar Araujo Castro

Criação: 30/03/2026

Atualização: 30/03/2026

Palavras: 1401

Tempo de leitura: 7 minutos

Resumo

A concordância entre avaliadores é central em pesquisas clínicas. O Kappa de Cohen, amplamente utilizado, pode gerar resultados paradoxais quando há alta ou baixa prevalência, subestimando a concordância real. O Gwet’s AC1 surge como alternativa mais robusta ao redefinir o cálculo do acaso, produzindo estimativas mais estáveis. Neste texto, é apresentado um exemplo clínico com cálculo das duas métricas, demonstrando como os mesmos dados podem levar a interpretações distintas. Compreender essa diferença é essencial para preservar a validade interna e evitar conclusões equivocadas em estudos médicos.

Introdução

A avaliação da concordância entre observadores é um dos pilares da confiabilidade em pesquisas clínicas. Em diversas áreas da medicina, como diagnóstico por imagem, classificação de feridas, interpretação de exames e decisão terapêutica, diferentes profissionais analisam os mesmos dados e precisam chegar a conclusões semelhantes. Tradicionalmente, o Kappa de Cohen tem sido utilizado para medir essa concordância, pois tenta estimar quanto do acordo observado vai além do que seria esperado pelo acaso. No entanto, essa abordagem apresenta limitações importantes. Em situações comuns na prática médica, especialmente quando há alta prevalência de uma categoria, o Kappa pode produzir valores artificialmente baixos, mesmo diante de uma concordância observada elevada. Esse fenômeno pode levar a interpretações equivocadas sobre a qualidade de um método diagnóstico ou sobre a consistência entre avaliadores. Para enfrentar essa limitação, foi desenvolvido o Gwet’s AC1, uma medida que redefine o cálculo do acaso e reduz a influência da distribuição dos dados. Compreender essas diferenças não é apenas um exercício estatístico, mas uma necessidade prática para garantir interpretações corretas e decisões clínicas mais seguras.

EXEMPLO CLÍNICO

Cenário

Dois médicos analisam 50 fotografias de feridas em membros inferiores e classificam cada caso em apenas duas categorias:

- Infecção grave, SIM

- Infecção grave, NÃO

Ao final, obteve-se a seguinte tabela:

| Médico B, SIM | Médico B, NÃO | Total | |

|---|---|---|---|

| Médico A, SIM | 1 | 1 | 2 |

| Médico A, NÃO | 1 | 47 | 48 |

| Total | 2 | 48 | 50 |

Vamos chamar as células da tabela de:

- a = 1

- b = 1

- c = 1

- d = 47

- N = 50

PASSO INICIAL COMUM AOS DOIS MÉTODOS

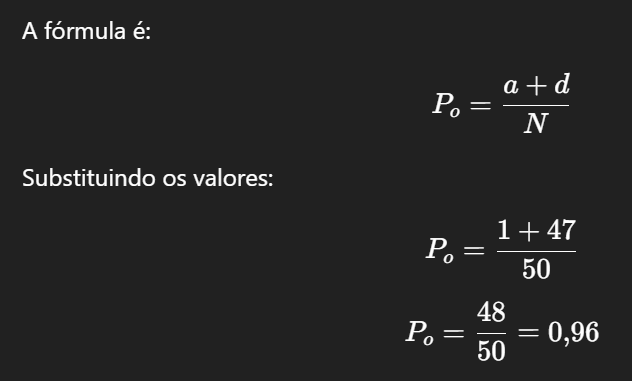

1. Concordância observada

A concordância observada, representada por Po, mostra a proporção de casos em que os dois avaliadores deram a mesma resposta.

Interpretação

A concordância observada foi de 96%. Isso significa que, em 48 dos 50 casos, os dois médicos concordaram. Mas ainda falta a pergunta mais importante: Quanto dessa concordância pode ter ocorrido pelo acaso? É aqui que o Kappa e o AC1 se separam.

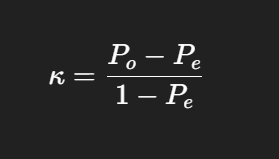

1. KAPPA DE COHEN

Ideia central

O Kappa de Cohen mede a concordância além do acaso, usando as proporções marginais observadas de cada avaliador.

A fórmula geral é:

Onde:

- Po = concordância observada

- Pe = concordância esperada ao acaso

Como calcular o Kappa neste exemplo

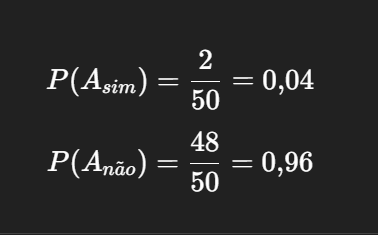

Passo 1. Calcular as proporções marginais do Médico A

O Médico A classificou:

- SIM em 2 casos

- NÃO em 48 casos

Logo:

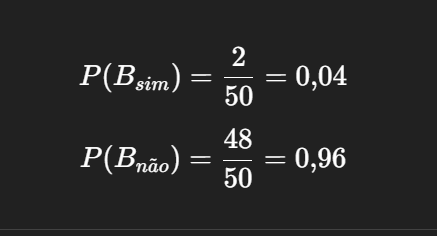

Passo 2. Calcular as proporções marginais do Médico B

O Médico B classificou:

- SIM em 2 casos

- NÃO em 48 casos

Logo:

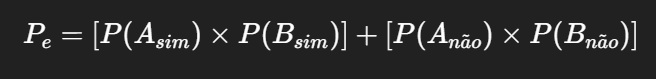

Passo 3. Calcular a concordância esperada ao acaso, Pe

No Kappa, o acaso é calculado assim:

Substituindo:

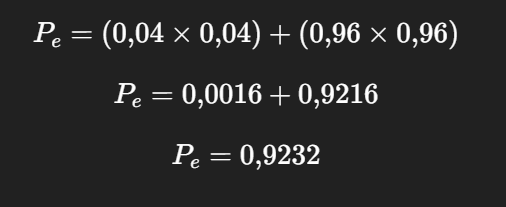

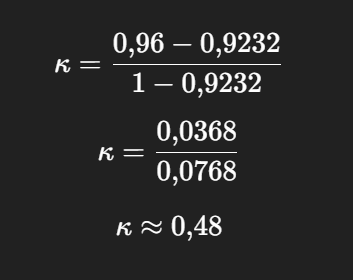

Passo 4. Aplicar a fórmula do Kappa

Agora usamos:

Substituindo:

Resultado do Kappa

Kappa de Cohen = 0,48

Interpretação

Essa concordância seria classificada como moderada.

Ponto crítico

Veja o contraste:

- Concordância observada = 96%

- Kappa = 0,48

Aqui aparece o paradoxo da prevalência. Como quase todos os pacientes foram classificados como NÃO, o acaso calculado pelo Kappa fica muito alto, e o valor final cai.

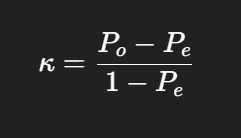

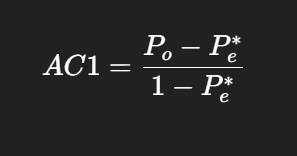

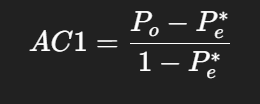

2. GWET’S AC1

Ideia central

O Gwet’s AC1 também mede a concordância além do acaso, mas usa uma forma mais estável de estimar esse acaso.

A fórmula geral é:

Onde:

- Po = concordância observada

- Pe* = concordância esperada ao acaso pelo método de Gwet

Como calcular o AC1 neste exemplo

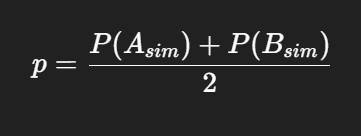

Passo 1. Calcular a proporção média da categoria SIM

No caso binário, primeiro calculamos a média das proporções de SIM dos dois avaliadores:

Substituindo:

Logo:

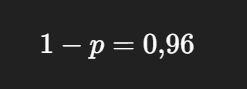

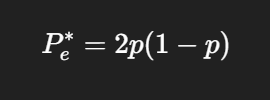

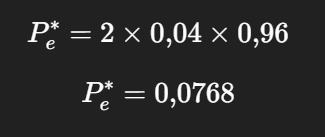

Passo 2. Calcular o acaso esperado no AC1

Para duas categorias, o acaso esperado no AC1 é:

Substituindo:

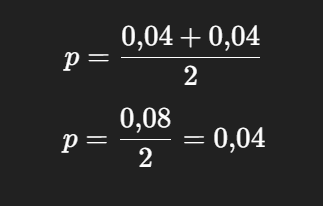

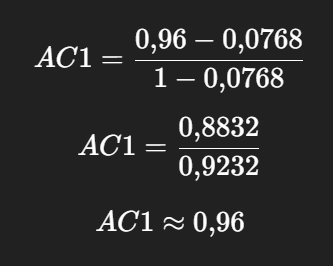

Passo 3. Aplicar a fórmula do AC1

Agora usamos:

Substituindo:

Resultado do AC1

Gwet’s AC1 = 0,96

Interpretação

Essa concordância seria classificada como quase perfeita.

Ponto crítico

Veja novamente o contraste:

- Concordância observada = 96%

- AC1 = 0,96

Aqui o resultado estatístico acompanha de forma muito mais fiel a impressão clínica do conjunto de dados.

COMPARAÇÃO FINAL DO MESMO EXEMPLO

| Medida | Resultado | Interpretação |

|---|---|---|

| Concordância observada | 96% | Muito alta |

| Kappa de Cohen | 0,48 | Moderada |

| Gwet’s AC1 | 0,96 | Quase perfeita |

O QUE O ESTUDANTE DE MEDICINA DEVE ENTENDER

1. O dado é o mesmo

Os 50 pacientes são os mesmos. A tabela é a mesma. Nada mudou nos dados.

2. O que muda é o modelo do acaso

A grande diferença está em como cada método estima a concordância esperada ao acaso.

3. O Kappa pode ser penalizado pela prevalência

Quando quase todos os casos pertencem à mesma categoria, o Kappa pode cair artificialmente.

4. O AC1 tende a ser mais estável

Em cenários clínicos reais, especialmente com eventos raros, o AC1 pode representar melhor a concordância verdadeira.

Frase de fixação

Nem toda concordância baixa no Kappa significa baixa reprodutibilidade. Em muitos casos, o problema está no modelo estatístico do acaso, e não nos avaliadores.

Considerações Finais

A análise da concordância entre avaliadores vai muito além de um exercício estatístico, trata-se de um componente central da qualidade metodológica em pesquisas clínicas e da segurança das decisões médicas. Ao longo deste texto, ficou evidente que duas métricas aplicadas ao mesmo conjunto de dados podem produzir interpretações profundamente diferentes. Esse fato, por si só, já exige uma postura crítica por parte do estudante de medicina.

O Kappa de Cohen, embora amplamente difundido, não deve ser utilizado de forma automática e acrítica. Em cenários clínicos reais, onde frequentemente há predominância de uma categoria, como ausência de doença, ausência de complicação ou ausência de infecção grave, o Kappa pode gerar uma falsa impressão de baixa confiabilidade. Isso pode levar à desvalorização de métodos diagnósticos adequados ou à conclusão equivocada de que há inconsistência entre avaliadores.

Por outro lado, o Gwet’s AC1 surge como uma alternativa mais robusta, especialmente em contextos de dados desbalanceados, oferecendo uma estimativa mais fiel da concordância real. Para o estudante de medicina, compreender essa diferença representa um avanço importante na formação em leitura crítica da literatura científica, permitindo identificar limitações metodológicas que muitas vezes passam despercebidas.

Na prática, esse conhecimento impacta diretamente áreas como diagnóstico clínico, interpretação de exames, classificação de doenças e validação de protocolos assistenciais. Saber escolher e interpretar corretamente uma medida de concordância contribui para decisões mais seguras, pesquisas mais consistentes e uma atuação profissional mais consciente.

Em síntese, não basta saber calcular, é essencial saber interpretar com rigor, contextualizar com a realidade clínica e questionar os resultados. É nesse ponto que a estatística deixa de ser apenas um número e passa a ser uma ferramenta real de melhoria da prática médica.

Calculadora onlinehttps://aldemararaujo.github.io/kappa/

Fontes

1. GWET, K. L. Handbook of Inter-Rater Reliability

- Reference: GWET, K. L. Handbook of Inter-Rater Reliability: The Definitive Guide to Measuring the Extent of Agreement Among Raters. 5. ed. Gaithersburg: Advanced Analytics, 2021.

URL: https://agreestat.com - Comentário:

É a principal obra para compreender o Gwet’s AC1, sua lógica matemática e sua aplicação prática em estudos de concordância.

2. FEINSTEIN, A. R.; CICCHETTI, D. V. High agreement but low kappa

- Reference: FEINSTEIN, A. R.; CICCHETTI, D. V. High agreement but low kappa, I. The problems of two paradoxes. Journal of Clinical Epidemiology, v. 43, n. 6, p. 543-549, 1990.

URL: https://pubmed.ncbi.nlm.nih.gov/2348207/ - Comentário:

Artigo clássico que explica de forma brilhante os paradoxos do Kappa, especialmente o efeito da prevalência sobre a interpretação da concordância.

3. WONGPAKARAN, N. et al. A comparison of Cohen’s Kappa and Gwet’s AC1

- Reference: WONGPAKARAN, N. et al. A comparison of Cohen’s Kappa and Gwet’s AC1 when calculating inter-rater reliability coefficients, a study conducted with personality disorder samples. BMC Medical Research Methodology, v. 13, p. 61, 2013.

URL: https://bmcmedresmethodol.biomedcentral.com/articles/10.1186/1471-2288-13-61 - Comentário:

Excelente artigo aplicado, útil para mostrar aos estudantes que a diferença entre Kappa e AC1 não é apenas teórica, mas pode alterar de forma concreta a interpretação de resultados reais.

Declaração de Uso de Inteligência Artificial Generativa (IAG). Declara-se que foi utilizada a ferramenta de Inteligência Artificial Generativa chatGPT, desenvolvida pela empresa OpenAI, como apoio na organização de ideias e na redação preliminar de trechos textuais deste trabalho e criação de imagens. O uso da ferramenta teve finalidade exclusivamente auxiliar na estruturação e revisão linguística do texto. Todas as decisões, interpretação, redação final e responsabilidade pelo conteúdo permanecem integralmente sob responsabilidade do autor.

***